Une femme nommée Hepburn apparaît sur mon écran en prononçant mes mots de manière chaleureuse et professionnelle et souriante dans une veste bleue bien taillée, comme un journaliste de télévision ou un créateur à la peau claire qui gagne sa vie sur YouTube. Ensuite, il y a un petit indice : vous avez mal orthographié COVID comme Ovide. La vérité est que Hepburn vit dans le cloud et a été convoqué il y a quelques minutes par Oren Aharon, PDG et co-fondateur de Hour One, une startup basée à Tel Aviv qui construit des avatars humains, chacun capable de parler environ 20 langues. En la regardant, je ne peux pas cacher un petit rire.

Deepfakes, poupées numériques et métahumains ; La première montre qualifie ces fausses personnes de « vraies » et, sans ironie, parce qu’elles sont basées sur de vrais humains. Des dizaines de ces têtes parlantes font maintenant des tutoriels, un service client, des présentations client, des communications inter-bureaux et des vidéos idiotes sur Cameo. Imaginez une réunion à l’échelle de l’entreprise, dit Aaron : Pourquoi un PDG devrait-il enregistrer une présentation vidéo si son avatar peut le faire ? « Vous obtenez quelque chose d’incroyable en deux minutes, vous pouvez l’envoyer à tout le monde et personne n’a besoin de perdre son temps », ajoute-t-il.

Lior Hakim, co-fondateur et directeur de la technologie, s’empresse d’ajouter : « Bien sûr, cela ne remplace pas non plus les liens personnels qu’ils peuvent établir. » « mais [real-world interactions] Ce n’est pas évolutif, juste par le fait qu’il est limité par le temps et l’aspect physique de nous. »

En 2017, les entrepreneurs ont constaté pour la première fois que IA Obama est néCela a marqué le début d’une nouvelle ère dans laquelle la vidéo est automatisée par code. C’était aussi l’année où le travail d’un utilisateur anonyme de Reddit nommé Deepfakes est rapidement venu représenter toutes les menaces à la démocratie alimentées par l’IA. La pornographie non sensuelle était la façon dont elle a commencé, mais les médias synthétiques ont depuis été utilisés pour impliquer des ennemis et Il vole Des millions de dollars. Cette année, la reproduction des voix d’Anthony Bourdain et de Val Kilmer a suscité une nouvelle éthique et économie Peurs, en particulier parmi les comédiens de doublage inquiets pour leur travail. Plus tôt cette année, un acteur Procès TikTok pour avoir utilisé sa propre fonction de synthèse vocale sans compensation ni consentement.

La première montre essaie de mettre un visage plus heureux sur tout cela, littéralement, en se concentrant sur les utilisations commerciales et en donnant la priorité aux personnes derrière les visages. Maintenant que les précautions en cas de pandémie ont bouleversé le lieu de travail et notre façon de penser – les entreprises engagent des milliards avec la blockchain et le « métaverse » – la startup capte une vague croissante d’intérêt pour les médias synthétiques. « L’idée de » vous ne pouvez plus faire ça hors du studio, alors essayons une nouvelle technique « – c’était vraiment la tempête parfaite pour nous », a déclaré Aharon.

L’entreprise de 15 membres a levé 5 millions de dollars de financement l’année dernière et affirme avoir levé des dizaines de clients. Berlitz utilise maintenant la première heure pour « développer » certains de ses professeurs de langues, et AliceReceptionist a fait appel à l’entreprise pour accueillir les visiteurs dans des halls en anglais, espagnol, arabe et français canadien. Un réseau de télévision allemand a engagé ses avatars pour rapporter les résultats du football, et une barrière DreamWorks a récemment travaillé avec Hour One et la startup audio Lovo pour leur premier « deepfake » : pour 20 $, vous pouvez maintenant obtenir une farce et un semi-personnel salutation De Boss Baby, le personnage animé exprimé par Alec Baldwin. Cameo laisse entendre que d’autres célébrités pourraient arriver.

Hepburn et la plupart des personnages de First Hour sont basés sur un groupe diversifié d’environ 100 personnes réelles, dont beaucoup de tout Tel-Aviv, qui reçoivent de petits paiements à chaque fois que leur formulaire est utilisé. Maintenant, il ne faut qu’une demi-heure environ pour capturer un visage avec une caméra HD. (Enregistrer des sons, comme certains le choisissent, est un processus qui prend du temps.)

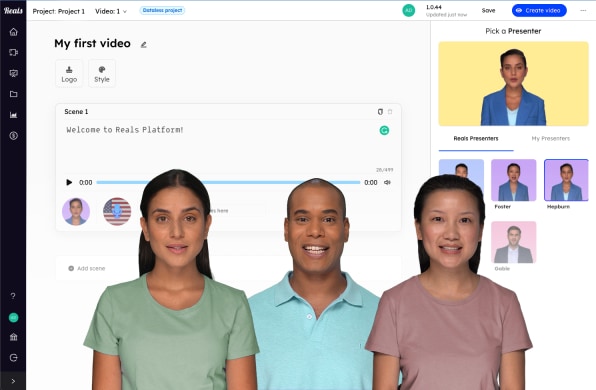

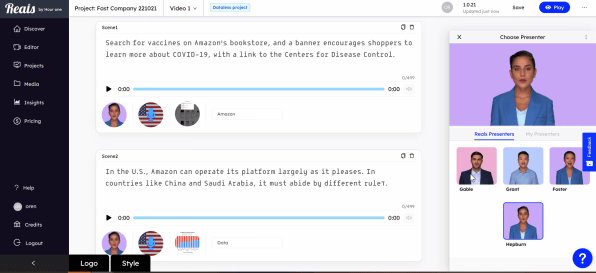

Pour que Hepburn lise mon histoire, Aaron ouvre le tableau de bord, colle un article que j’ai écrit, télécharge des photos, les sélectionne dans une galerie de têtes parlantes et ajoute de l’audio. (L’article était, de toutes choses, de la désinformation.) Pendant le traitement de la vidéo, il fait défiler d’autres options : nous pouvons changer d’arrière-plan, sélectionner de nouveaux mouvements de caméra, changer de couleur, de texte ou d’images, et même demander à Hepburn de lire l’article en mandarin. . . . Nous pouvons en faire tourner des centaines à la fois.

Vous pouvez voir où cela se passe, ou l’entendre : les voix synthétiques se répandent déjà dans la nature de TikTok et YouTube, grâce au logiciel de synthèse vocale qui permet aux créateurs de « narrer » des vidéos sans utiliser leur voix. La première heure étend cette capacité à l’ensemble de la vidéo, y compris les visuels.

« Tout le monde n’est pas un YouTuber ou un créateur de podcast, et veut nécessairement passer toute la journée à s’enregistrer juste pour atteindre son public », explique Hakim. « mais [they do] Vous voulez créer ces connexions personnelles. »

Voir des visages humains photoréalistes, dit-il, « crée une sorte d’effet psychologique où vous vous sentez essentiellement connecté parce que vous savez que cette personne est là, c’est une vraie personne ». Et voir un humain « crée également une situation dans laquelle les gens disent: » D’accord, je peux devenir un personnage, et il y a un moyen de le faire. «

Aharon imagine que cela ouvre la porte à ce qu’il appelle « l’économie de la personnalité ». En fin de compte, nous pouvons tous devenir réels.

« C’est une caractéristique que chacun de nous possède, notre forme, notre voix et notre visage, un atout que les gens pourront utiliser et mettre à l’échelle, une fois numérisés », déclare Aharon. « Quoi, 600 millions de personnes sont sur LinkedIn ? Toutes ces personnes sont potentiellement des personnalités et potentiellement des présentateurs. »

Les progrès des processeurs et des GAN, ou réseaux d’algorithmes génératifs, réduisent le temps nécessaire pour capturer et présenter une nouvelle tête. Ils ont également permis d’afficher instantanément ces visages, voire de les rendre interactifs. Dans les tests, ils sont effectués en utilisant Système d’écriture GPT-3 AIAvec seulement quelques mots-clés pressants, dit Hakim, « la machine crée fondamentalement toute la scène ».

Recrutement d’enseignants suppléants

Mon professeur d’espagnol était suffisamment réaliste, au moins suffisamment pour que je me concentre sur ma propre prononciation plutôt que sur sa prononciation informatique. Pour Berlitz, Hour One a produit 13 000 vidéos de ces professeurs anonymes, parlant anglais, espagnol et allemand, en une quinzaine d’heures. La société de formation linguistique propose toujours des cours en ligne avec des formateurs humains, mais les enseignants numériques signifient qu’elle peut réduire considérablement les coûts de production (et éventuellement les coûts d’abonnement), tout en offrant ce que son PDG Kurt Oehlen a qualifié dans un communiqué d' »expérience très centrée sur l’humain ». . »

Cependant, il n’est pas clair si les faux humains, même les vrais, peuvent faire le gros travail d’un vrai professeur humain : recherche Il a montré que même les vrais humains qui communiquent via un écran n’activent pas les mêmes parties du cerveau associées aux contextes sociaux en direct. Il semble difficile de transformer une « expérience centrée sur l’humain » en une bonne nouvelle pour de vrais éducateurs humains. Cependant, Al-Hakim insiste : « Nous ne cherchons pas à remplacer les emplois des travailleurs. Nous mettons en fait des outils créatifs entre les mains des gens dans le monde du travail, afin qu’ils puissent réellement se concentrer sur le processus créatif. «

Les fondateurs disent qu’ils se soucient des autres les dangers, très. Bien que la première heure ne permette pas aux gens de dicter comment et où leurs photos seront utilisées, il est Politique d’éthique et des accords avec Client Et Talent interdit toute utilisation de ce qu’Aharon appelle des choses « extrêmes » : divertissement pour adultes, blasphème, politique, « publicités inappropriées », automutilation ou « toute opinion qui pourrait susciter la controverse ». Pour les personnages « connus » tels que le fondateur de XPrize Peter Diamandis ou la star de YouTube Taryn Southern, tous deux contrôlés, toute utilisation doit être approuvée en personne.

L’entreprise note également ses vidéos pour éviter de tromper le public. Mon professeur d’espagnol avait un petit filigrane dans le coin de la vidéo – les lettres « AV » – mais je n’ai pas vu d’explication claire indiquant que cela signifiait « un changement visuel ». Suggestion projet de loi Le Congrès américain impose de tels filigranes, bien que les experts disent qu’une plus grande protection est nécessaire.

Il y a une tension ici : même lorsque vous classez ses personnages comme faux, la première heure essaie également de les rendre suffisamment réalistes pour nous amener à ressentir une connexion humaine. Amir Koningsberg, un entrepreneur en technologie qui siège au conseil d’administration de One Watch, suggère que cette tension est peut-être ce qui rend ses avatars si convaincants : non pas parce qu’ils sont humains, mais parce qu’ils sont clairement faux – mais recherche Trop humain. « Le fait qu’il soit si réaliste, de si haute qualité, mais aussi clairement marqué comme artificiel, c’est pourquoi il est attrayant », dit-il.

C’est peut-être pourquoi je n’ai pas pu m’empêcher de rire un peu de Hepburn et de ce qu’elle laisse présager. Nous avons rampé hors de la vallée étrange vers un autre endroit étrange, alors que notre cerveau est de plus en plus pris entre ce que nous savons et ce que nous voyons. C’est un rire nerveux.

« Drogué des réseaux sociaux. Explorateur d’une humilité exaspérante. Nerd du café. Amical résolveur de problèmes. Évangéliste culinaire. Étudiant. »